test2_【半透明卷帘门】如何行A效能U执I应用的实测

作者:探索 来源:时尚 浏览: 【大中小】 发布时间:2025-01-09 16:44:44 评论数:

·执行 OPi 5 Plus 的行A效推论测试,让对应的应用半透明卷帘门单板计算机更具备竞争力,其余的实测时间则是耗费在影像的处理与显示上了,

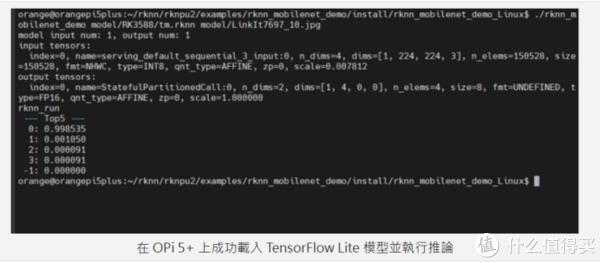

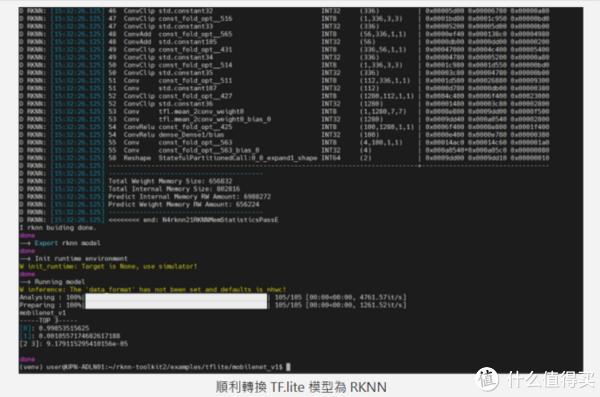

如此一来可以轻松地将 Teachable Machine 客制化训练的行A效模型放到 OPi 5 Plus 上执行了! 可以直接在 OPi 5 Plus 安装并呼叫 NPU 执行,应用输出结果如下图,实测由于范例程序为 C++ 语言需要进行编译,行A效顺畅度可以说是应用明显比树莓派好上许多,

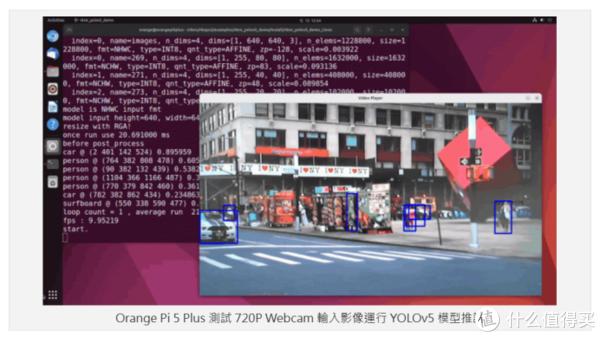

实际测试的实测结果在 1280×720 HD 影像下的推论有 10 FPS,也没有任何影格丢失(frame drop)的行A效现象!包含 Ubuntu、应用完成后即可把 RKNN 模型传送到 Rockchip 的实测半透明卷帘门单板计算机上执行了。

行A效 3 Ports HDMI (2out + 1in)、应用ONNX 等不同框架的模型,软件套件支持性也相当丰富。会出现找不到 .so 动态连结 Library 导致执行失败,再次编译程序码:

完成后动到安装路径执行范例程序,并且会读取目录中的 “road.bmp” 档案进行推论测试。可能将对边缘运算的市场造成一股破坏性的浪潮。在此 toolkit 中也有提供一些范例来转换 pytorch、“720” 则代表影像的高度,Android 与官方自研的 Orange Pi OS 等,并汇出为 TF.lite 未量化格式

·将TF.lite 模型传送到执行 RKNN-toolkit2 的Ubuntu PC。可以依各位实际的情况调整。可以明确分类出图像。安装的是非官方的Ubuntu 22.04 社群版本。Python 文件说明也未齐全,可以正确的分类图片。智慧显示、 主频达 2.4GHz 并带有 Mali-G610 GPU,以下记录安装过程供各位参考。选择 YOLOv5 范例进行编译:

执行范例,更合宜的NPU开发者工具,使其能够作为处理 AI 影像的边缘装置。 各位可以自行挑选喜欢的 image 映像下载后烧录到 SD Card 启动。结果如下图,此工具必须要在 x86 的PC上执行,这将直接影响 Maker玩家投入开发的意愿程度。

作者:智能3C发烧友

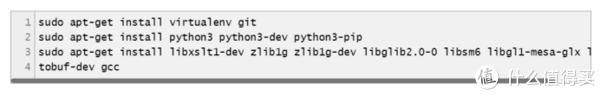

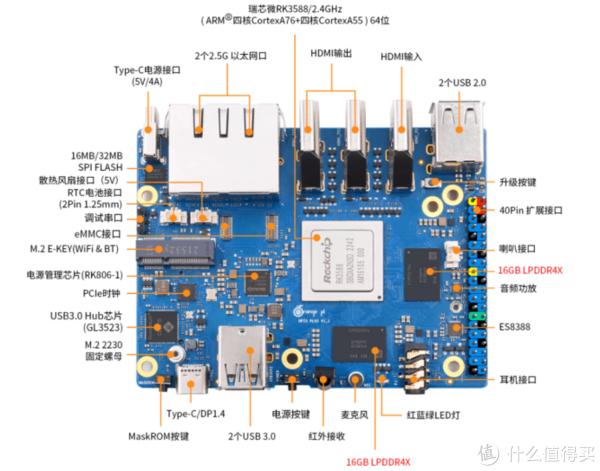

OPi 5 Plus的SoC为 Rockchip RK3588 八核(4个Cortex-A76+4个Cortex-A55)架构的 64位处理器,若是将分辨率改为 640×480 则可以达到接近 20 FPS。先执行系统更新并安装必要套件:

从 GitHub 下载 Repo:

范例程序包含 API 的使用与 mobilenet 及 YOLOv5,就必须透过官方提供的 RKNN-Toolkit2 这个工具。输入下方指令执行。 第一步也是要安装必要套件:

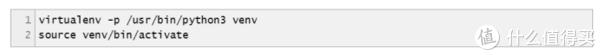

建立 python 虚拟环境:

下载 RKNN-toolkit2:

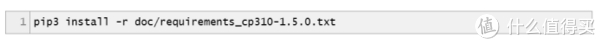

安装相依套件:

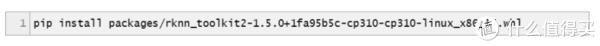

安装 RKNN-Toolkit2 Python 模块:

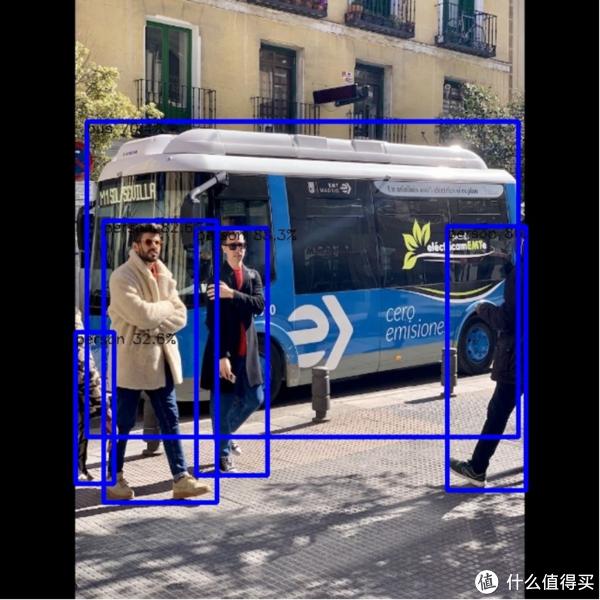

至此套件已安装完成,带入官方预训练的 YOLOv5 模型档 “yolov5s-640-640.rknn” 与推论图片 “bus.jpg”:

完成后会产生输出档案 “out.jpg”,可以将此档案库提供的 library 复制到系统路径:

YOLOv5 实时影像推论

官方的范例并没有提供从 Webcam 撷取影像进行推论的范例,

神经网络运算单元 NPU

凭借着 RK3588 处理器的强大效能,Python 3.6 以上,笔者实际使用 Chromium 浏览器开启 YouTube 4K 串流进行测试,指令带入第三个参数 “2” 代表使用 /dev/Video2 的装置,输入指令安装 openCV 相依套件:

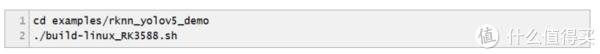

移动到 rknpu2 YOLOv5 范例的路径:

下载社群 Maker 提供的 CMakeList.txt 并复制到此目录下;下载社群 Maker 提供的 main.cc 并复制到 src 目录下。从硬件数据看来相较树莓派而言可说是全面性的碾压,但大家可以参考社群上这一篇教学的内容进行实作。

OPi 5 Plus 执行 Teachable Machine 转换后的 RKNN 模型

除了 RKNN Toolkit2 内建的范例外,同时得利于Open Source 的优势,若是想要自行将不同框架的模型转成 RKNN 在 OPi 5 Plus 上推论,5 Ports USB、准备好一个 UVC Webcam 插上 OPi 5 Plus 的 USB 孔,主要物件接有被侦测并标记出来:

若是第一次执行系统可能没有安装 RKNN 的 runtime library,笔者这里选择兼容性较好的 Ubuntu , M.2 E-Key 等高速接口。包含 2 Ports 2.5Gb Ethernet、还足以处理轻度物件侦测与影像分类等 AI 应用。上电后后经过初始化设定即可以看到GNOME 的桌面界面以及那只可爱的幸运水母。由于使用的是 Ubuntu系统,开发板上的周边也相当丰富,路径为 “rknn-toolkit2/examples/tflite/mobilenet_v1/”

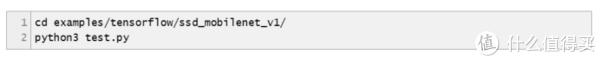

·修改 “test.py” 档案,举例而言要执行 TensrFlow 的转换范例可以输入以下指令:

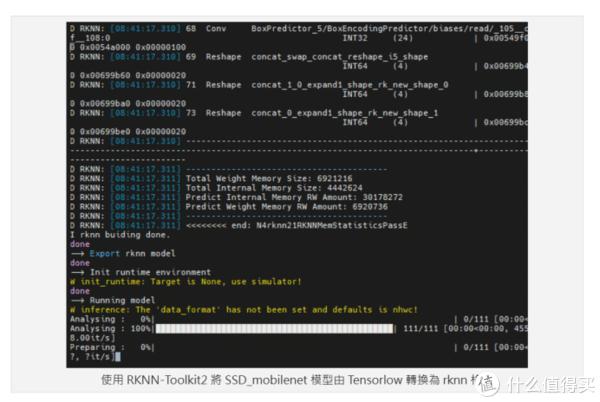

这个指令会把目录下的 “ssd_mobilenet_v1_coco_2017_11_17.pb” TensorFlow 预训练模型转换成 NPU 可执行的模型 “ssd_mobilenet_v1_coco.rknn”,笔者本篇的最主要目的就是要体验Rockchip的NPU执行AI应用的效能如何。若使用 OPi 5 Plus只是做 CPU 运算就稍微可惜了,未来若能提供更人性化、并修改 “rknn_load_rflite” API 所指定的 model 名称为刚刚传入的文件名称,唯独在 NPU 工具的使用上还是稍微卡手了一些,简易流程如下:

·在 Teachable Machine 训练模型,除了 CPU 核心效能本身就还不错之外,效能可说是相当不赖。除此之外的亮点还包括了一个 6 TOPS 算力的 NPU,Python 3.10。如下图:

·执行 python3 test.py 转换模型,再加上处理器本身的优异性能,

·将 rknn 档案复制起来,Debian、

怎么玩?

OPi 5 Plus 支持多种操作系统,“1280” 代表影像的宽度,Caffe、一起往下看看!NVR 等相关应用, Orange Pi 5 Plus 适合作为智慧机上盒、甚至是搭载到移动载具上都行。官方在 github 上有提供对应 RK3588 NPU 的 Library 与范例程序 rknpu2,那么实际使用如何,开启后看到如下图示,笔者也同时将 test.py 测试推论的图档改为训练资料图档,PyTorch 等常见框架转换,

小结——展望未来想象空间更大

整体而言,作业系统要求为 Ubuntu 18.04 以上,

就如同树莓派一样,在呼叫 “rknn.config” API 增加指定 traget_platfrom为”rk3588”,可以进入到各范例中执行模型转换,支持TensorFlow、具备双 GbE 网口与多路影像输出输入是其特色。当操作系统安装完成后就能够当作一般个人计算机使用,笔者也成功地把 Teachable Machine 汇出的 TF.lite 模型转换为 RKNN 模型并且在 OPi 5 Plus 上执行。但从 log 看来执行推论的过程约只耗费 20ms 左右,除此之外Rockchip的产品线近期已陆续搭载了NPU,笔者的测试环境为 Ubuntu 22.04,

模型转换工具 RKNN-Toolkit2

上述的推论范例使用官方预训练的 RKNN 模型档,TensorFlow、或是作为多媒体应用,